����STM32��openmvĿ�����ϵͳ�����

Ŀ¼

һ��ѡ�ⱳ�����о�����

�����������о�״��

�����о�����Ҫ����

�ġ�ϵͳ�������

�塢ϵͳӲ�����

����ϵͳ�������

�ߡ�ϵͳ����

�ˡ��ܽ�

�����

һ��ѡ�ⱳ�����о�����

�������ճ�������У�����ģʽʶ���㷨��Ŀ������㷨����ɫʶ���㷨��Ŀ���������ʶ�𣬲�����̨��ϵ�����ģʽ�ѽ�ʮ���ձ飬���繫��ʹ�õ�����ϵͳ���ǹ̶���̨��ʶ������ͷ�ĵ��ͣ������������������ǵ�ʵ�ʲ��������ķ����ɹ㷺Ӧ���ڰ�����������������ڵ�ǰ����£���������ճ������Ӧ���о��кܺõ����������Լ���ʵ���塣

����Ƶij������ڽ����ǰ������һЩ���ޣ��ر����������Ŀ�����ϵͳ�д��ڵ��������⡣��һ����������ͷ�ǶȺ�λ�õ����ƣ�ϵͳ�������Բ���Ŀ����������ͼ�����Ƶ������������ʶ��������ƫ������Ŀǰ�����ϵͳ����������ͷ���и��٣���������ͷ�ڲ�Ŀ��ʱ�����ڶ�άƽ���ڶ�λ������ʵ��Ŀ���������άλ��ȷ������ʹ�õ�Ŀ���Զ���ӽ�ʱ��ϵͳ����ʧ�������������ֳ����ȶ��ĸ��١�Ϊ�˽����Щ���⣬���ǽ�����������о�����ƣ���������Ŀ����ٵ�ȷ�Ժ��ȶ��ԡ�

�����������о�״��

Ŀ�����ϵͳ���о�ʼ��1966��PRI��Bledsoe�Ĺ���������ʮ�����õ��˷��ٵķ�չ�������˾��ֵġ�9.11���¼���������Ĺ���Ͷ�뵽Ŀ�����ϵͳ���о��У�������������ӣ���������������˾�����ʽ����������������ĸߵ�ѧ������һ�������о��ѽ��е������ݱ�����У��������о��������������ʡ����ѧԺ������˹�ٴ�ѧ��Ӣ���Ľ��Ŵ�ѧ���ձ��Ķ�����ѧ���ҹ����廪��ѧ���й���ѧ������ѧ�ȡ�

�����о�����Ҫ����

���о�����STM32��OpenMV�����Ŀ�����ϵͳ��ͨ�����������ϵͳ��ʶ�𱻲����壬�����ƶ��ʹOpenMV����ͷ��Ŀ�ꡣ��ϵͳ���巽������У���Ŀ�����ϵͳ�ķ�չ��Ӧ�ü�ѧ���о���״������������������ݴ˹�˼��ϵͳ������ܹ�����Ӳ����Ʒ��棬����STM32��GPIO�ӿ���OpenMV����ͷ�������ӣ���������Ʒ��棬ͨ��STM32�̼�ͨ�ź�OpenMV�Ӿ��㷨ʵ�ֶ�Ŀ������ĸ��ٿ��ơ���Ӳ�����ϵ������������У�ͨ�����Ŀ����������ʵ����ϵͳģ��Ĺ���չʾ�����Ӷ���Ƕ���֤��ϵͳ���ݵ���ȷ�ԡ����ܵ��걸���Լ����ܵ��ȶ��ԡ����о��ɹ�ΪĿ����ټ����Ľ�һ��Ӧ���ṩ������֧�ֺ�ʵ���ο���

�ġ�ϵͳ�������

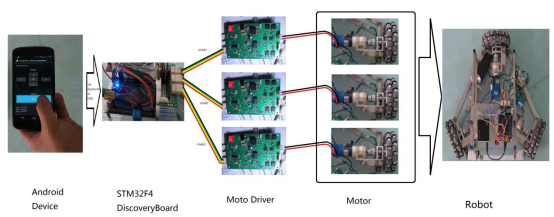

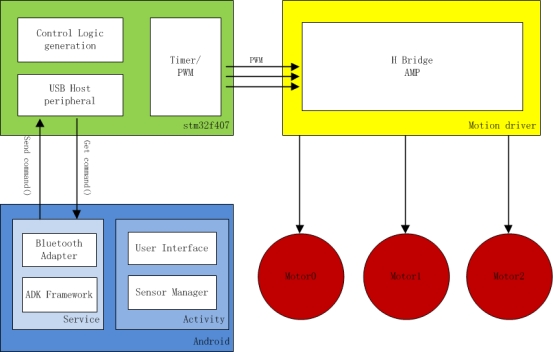

��ϵͳ��������IJ�����ɣ��˶�ƽ̨���Ӿ�����ƽ̨���˶�ƽ̨�ĺ����������Android�豸����չ���Լ�ִ�л��������У�ִ�л�����Ϊ����ϵͳ�����ж�����̬�������������Dz��õ����ɵ�������������������ɵ�ȫ��λ�ƶ�ƽ̨�����Ӿ�����ƽ̨����Ҫ������ͷ�����ذ��LCD��ʾ�����ɣ������������Ӿ���Ϣ��

ͼ �Ӿ�����ϵͳ

ͼ �˶��������

�塢ϵͳӲ�����

��ϵͳ�����Ŀ����ʵ�ִ��������ݵIJɼ�����̬���㡢�������������Լ����������ִ�С�Ϊ�����̿���ʱ�䣬����ѡ���˹㷺ʹ�õ�LG Nexus 4�ֻ���ΪAndroidƽ̨������չ���������STM32F4 Discovery������һ��ٷ��ṩ�ĵͳɱ������塣

ͼ2-3 ģ���ԭ��ͼ

ͼ2-4 �������ԭ��ͼ

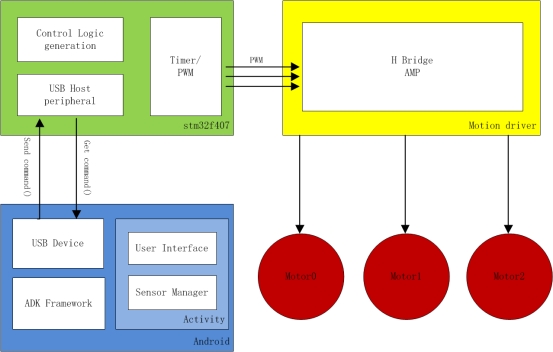

����ϵͳ�������

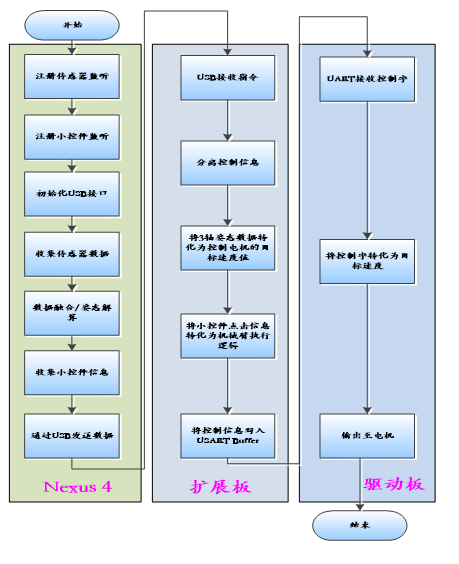

�ڱ�ϵͳ����������У����ǽ��仮��Ϊ������Ҫ���֣�Android������ơ���չ����������Լ�������������ơ�����Android�豸�����������һ��Activity�࣬����༯���˶�ȡ���������ݡ�������̬���㡢��ⰴť״̬�����Ϳ���ָ���Լ�ˢ���û�����ȶ���ܡ�������չ�����������У�������Ҫʵ����USBH��Ĺ��ܣ�������Ϣ�Ķ�ȡ������ת��Ϊ�����Ŀ���ٶȡ����ڵ���������������Ҫʵ����UART��ȡ��PWM�ź������Լ��������������ݵĶ�ȡ�ȹ��ܡ�����֮�����������ֵ�����Эͬ������ȷ��������ϵͳ���ȶ����С�������Ƶļ�Ҫ������ͼ3-9��ʾ��

ͼ ϵͳ��������ܹ�ͼ

�ߡ�ϵͳ����

��̬���ƽ̨���Բ�����������꾡���ԣ�(����ͼ��ʾ��

��a����̬1��(-158,36,11) ��b����̬2 (-88,-2,0)

��c����̬3 (-88,2,74) ��d����̬4 (-77,-2,-4)

ͼ4-1 ��̬�����Խ��

ͨ����ͼ��չʾ�����������ؿ����ֻ���Yaw��Pitch��Roll����ȷ�ط�ӳ����ʵ����̬���Ӷ���Чʵ������̬�ɼ���Ŀ�ꡣͬʱ������Ҳ���ֻ�����չ��֮���ͨ�Ž�������֤��ȷ��ͨ�ŵ�˳�����ȶ�����֤��������ͼ4-2��4-3��

ͼ4-2 �������Խ��

ͼ4-3 USB�������Խ��

�ˡ��ܽ�

��ϵͳͨ������Androidϵͳƽ̨��STM32F4ƽ̨���ɹ�������һ��������������û�����ƽ̨����ϵͳƾ����ͳɱ��������Լ���ɫ�������ص㣬��ַ����˲�ͬӲ��������ƽ̨�����ƣ�չ�ֳ���ǿ�����չ��������δ�������Ǽƻ���һ����չ�ⲿ����������ʵ�ָ�Ϊ���ӵĿ��������Բ�������ϵͳ�Ĺ��ܺ����ܡ�

�����

[1]���������꣮Ŀ����ٻ�е�۵��˶�ѧ�о�[J]������װ������ѧ����2019��40( 10) : 200��204��210��

[2]�Էɷɣ�������Ƶ��Ŀ�������ʶ��[D].������ҵ��ѧ��2016.4

[3]Ԭ�ʻԣ����ڻ�е�ֵ�˫Ŀ�Ӿ���λץȡ�о�[D].��ɽ��ѧ, 2016.5.

[4]Ҧ��Ӱ�ӽ�ɫĿ��������滻���о���Ӧ��[D].������ҵ��ѧ��2015.6.

[5]�����ܣ��߾����ŷ���̨�Ļ�е�ṹ�����ϵͳ�о�[D].�㽭��ѧ��2014.9.

[6]����������ѧ���̵���[M]������������������ѧ������.2005.

[7]�Ŵ�ƽ,�չ��. Ŀ�����ϵͳ����[J].�й�ͼ��ͼ��ѧ��: A ��, 2000 (11): 885-894.

[8]������. ����Ŀ���˶��켣���ռ�ֲ�����Ϊ�����о�[D].���ϴ�ѧ˶ʿѧλ����,2009.

[9]�����������������Ц. ����STM32��OV7670��ͼ��ɼ�����ʾϵͳ���[J]�� ��������ϵͳ��2016( 9) : 114��117��

[10]���Ӻƣ� �����Ӿ��ڶ������ڵ�Ӧ��[J]�����Ӽ������������̣�2018( 1) : 93��94��

[11]���ģ��������ذظ���Ŀ����ټ�������[J]���й���ѧ��2014��7( 3) : 365 �� 375��

[12]Robust Real-time Object Detection. Paul Viola, Michael Jones. IJCV 2004.3.

[13]Huang C L, Chen C W. Human facial feature extraction for face interpretation and recognition[J]. Pattern recognition, 1992, 25(12): 1435-1444.

[14]Cox, I. Ghosn and J. Yianilos. Feature-based Face Recognition Using Mixture Distance. Processings Intelligence Conference Computing Vision. Pattern Recognition. 1996:209~216

[15] Xiaoou Tang,Surpassing Human-Level Face Verification Performance on LFW with GaussianFace[J]. Department of Information Engineering, The Chinese University of Hong Kong,2014.

[16] T. L. Griffiths and M. Steyvers. Finding scientific topics. Proceedings of the National Academy of Sciences, 101(Suppl. 1):5228�C5235, April 2004.